2026 年液冷技術如何重塑 AIDC 效能

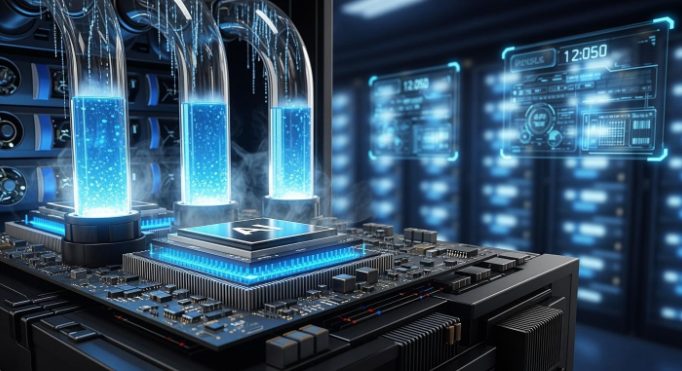

隨著液冷技術成為滿足現代工作負載需求的關鍵方案,您將看到 AI 資料中心 正經歷重大變革。這項技術如今在產業中佔據主導地位,幫助您應對高功率密度挑戰並提升營運效率。在數位基礎建設高度發達的地區,例如 香港伺服器租用 環境中,液冷在支援高效能 AI 叢集的同時,也在保障能效與空間最佳化方面發揮關鍵作用。

優勢 | 說明 |

|---|---|

能源效率 | 相較風冷提升最高可達 15% 的能效。 |

冷卻成本降低 | 顯著降低冷卻相關成本。 |

伺服器密度 | 支援更高的伺服器密度,滿足 AI 工作負載需求。 |

硬體壽命 | 延長硬體元件的使用壽命。 |

空間與維護 | 減少占地空間與維護需求。 |

藉助液冷技術,您可以讓系統維持峰值效能運行,延長硬體壽命並降低成本。隨著 AI 工作負載持續成長,業界專家一致認為,這種方案不僅高效,而且已成為營運所必需。

核心要點

與風冷相比,液冷可提升最高 15% 的能源效率,從而實現顯著成本節省。

該技術支援更高的伺服器密度,使資料中心能夠高效承載現代 AI 工作負載。

透過減少熱應力,液冷延長硬體壽命,確保長期穩定運行。

採用液冷有助於降低能耗與碳排放,實現永續發展目標。

投資液冷技術,是讓資料中心在 AI 時代保持競爭力的關鍵舉措。

液冷對 AIDC 的影響

效能與效率提升

當您將資料中心升級為液冷系統時,會看到運作方式的顯著提升。如今 70%–80% 的先進 AI 資料中心已採用液冷技術,顯示其產業主導地位。您可以支援每機櫃 200 kW 甚至更高的功率密度,這是傳統方式無法實現的。

指標 | 說明 |

|---|---|

計算電力效率(PCE) | 從風冷約 0.4 提升至 0.9 以上,實現更高電力轉換效率。 |

水資源使用效率(WUE) | 設施層級接近 0 WUE,比浸沒式系統減少 80% 冷卻液使用量。 |

永續性 | 降低能耗與用水量,並透過減少熱應力延長硬體壽命。 |

成本因素 | 儘管初期投資較高,但長期營運成本更低。 |

您可以實現源頭直接散熱、更高效的熱傳導,並減少對機械式冷凍機的依賴。這意味著更低的能源與維護支出。大型資料中心每年可節省高達 400 萬美元的冷卻成本。當冷卻液溫升允許達到 20°C 時,冷卻能耗可降低 40%,用水量最多可減少 60%。

提示:採用液冷技術,可讓硬體維持峰值效能運行,避免因過熱導致的效能下降。

更高密度與可擴充性

隨著 AI 工作負載持續成長,您需要在有限空間內部署更多算力。液冷使這一目標成為可能。現代 AI 系統通常需要每機櫃 40–250 kW 的功率。傳統資料中心冷卻方式無法支援超過 15 kW/機櫃,而液冷則能輕鬆應對更高密度。例如,NVIDIA 的 GB200 NVL72 機櫃功率約為 140 kW,未來系統甚至可能達到 250 kW。

功率密度(kW/機櫃) | 說明 |

|---|---|

100+ | 適用於先進 AI 工作負載的高密度環境。 |

140 | NVIDIA GB200 NVL72 機櫃實現的功率。 |

250 | 下一代系統預計功率。 |

您可以放心擴充業務,無需擔心過熱或效能下降。液冷支援每機櫃部署更多伺服器,減少空間占用,並避免熱降頻現象,使資料中心擴充更加高效。

液冷滿足現代 AI 工作負載需求。

支援更高功率密度管理。

是高效能運算運行的關鍵保障。

永續發展進展

採用液冷技術,您將在提升資料中心永續性方面發揮重要作用。該技術幫助降低能耗與用水量,支援綠色發展策略。先進液冷結合更高伺服器使用率,可降低 7% 的二氧化碳排放。用水量減少 29%,配合其他最佳化措施,整體可降低 32%。若選址於水資源壓力較小地區並採用高效冷卻方式,用水需求最多可減少 52%。

優勢 | 說明 |

|---|---|

降低碳足跡 | 減少整體能源使用 |

熱水再利用 | 可為建築或周邊設施供熱 |

閉環系統 | 透過高效設計節約用水 |

支援高密度邊緣部署 | 減少對 HVAC 系統的依賴 |

您還可以協助企業實現全球永續發展目標與 ESG 指標。對於希望保持競爭力與社會責任感的資料中心而言,液冷已成為必然選擇。

風冷的侷限性

功率與熱限制

當您依賴風冷系統時,將面臨嚴格限制。風冷通常僅能支援每機櫃 50–100 kW 的功率密度。現代 AI 晶片單顆可產生高達 1,200 瓦的熱量,這對冷卻系統造成巨大壓力,也顯著增加用電量。在部分地區,資料中心已占到總電力消耗的 20%。而僅風冷系統本身,就可能消耗設施總電力的 40%。

指標 | 數值 |

|---|---|

機櫃密度 | 50–100 kW |

晶片級熱功率 | 單顆最高 1,200 瓦 |

資料中心用電占比 | 2024 年愛爾蘭總電力的 20% |

風冷電力消耗 | 最高占設施總電力的 40% |

這些限制使擴充變得困難。隨著 AI 工作負載成長,您所需的功率與散熱能力已遠超風冷所能承載。

熱降頻風險

風冷還會帶來系統效能下降的風險。灰塵與顆粒物會沉積在電路板上,阻礙氣流並提升溫度。風扇與散熱器積塵後效率下降,導致溫度驟升。硫氧化物、氯氣等腐蝕性氣體會損害金屬元件,引發故障。濕度控制不當可能產生冷凝水或靜電放電風險,皆會威脅硬體安全。

風險類型 | 說明 |

|---|---|

顆粒物污染(PM) | PM2.5 與 PM10 可沉積在電路板上,增加短路風險並阻礙氣流。 |

灰塵堆積 | 灰塵降低散熱效率,引發溫度驟升與熱降頻。 |

腐蝕性氣體 | 損壞金屬表面,導致訊號遺失與機械故障。 |

濕度風險 | 濕度過高會冷凝腐蝕,濕度過低增加靜電風險。 |

當冷卻系統無法即時散熱時,硬體會自動降頻以避免過熱,從而導致效能下降,並縮短設備壽命。

為何風冷無法滿足 AI 需求

AI 工作負載使資料中心面臨前所未有的挑戰。與傳統伺服器任務相比,AI 應用產生的熱量可高出十倍。現代 AI 加速器長時間滿載運行,使熱管理更加困難。您必須採用先進冷卻方案才能有效應對。

AI 運算比一般雲端應用消耗更多能源。

高密度設備產生大量熱量,風冷難以有效控制。

強制送風系統在邊緣部署或城市緊湊空間中的效率有限。

物理定律不會說謊——傳統風冷已無法應對下一代 AI 工作負載的熱密度。這不再是偏好問題,而是技術可行性問題。

因此,液冷不僅僅是升級選項,而是現代 AI 資料中心的必然選擇。

液冷技術類型

直冷到晶片(Direct-to-Chip)

直冷到晶片技術將冷板直接安裝在處理器與記憶體上,從源頭帶走熱量。系統可採用單相或雙相冷卻方式。單相系統中,冷卻液吸熱後輸送至熱交換器;雙相系統則利用特殊液體在吸熱後蒸發,將熱量帶走。

相較風冷,顯著提升能源效率。

提升資料中心冷卻密度,支援更高伺服器部署量。

減少對 HVAC 系統依賴,運行更安靜。

提升可靠性與效能。

設計更具彈性,便於升級。

透過提高機櫃算力密度降低整體擁有成本。

浸沒式冷卻

浸沒式冷卻將伺服器完全浸入專用礦物基絕緣液體中。該液體吸收設備產生的全部熱量,大幅減少對空氣冷卻的需求。單個冷卻槽可處理高達 100 kW,適用於高效能 AI 與 HPC 工作負載。系統可按 240 kW 為單位擴充,便於未來規劃。同時,此方式有助於降低二氧化碳排放。

對 AI 工作負載的重要性

面對現代 AI 需求,液冷提供遠優於風冷的熱管理能力。其散熱效率高出 2–10 倍,溫度可降低 15–30°C。這樣的能效水準是保障高密度 AI 運算穩定運行的關鍵。

冷卻技術 | 散熱效率 | 溫度降低 | 適用場景 |

|---|---|---|---|

液冷 | 高出 2–10 倍 | 降低 15–30°C | 高密度運算 |

風冷 | 基準水準 | 溫度較高 | 一般應用 |

提示:若希望資料中心具備未來競爭力,應優先部署直冷到晶片或浸沒式冷卻系統。

2026 年液冷的核心優勢

能源效率與成本節省

從營運成本角度來看,液冷為您帶來顯著優勢。該技術可支援遠高於風冷系統的機櫃密度,並將冷卻能耗最多降低 90%。對於 40 kW 機櫃,投資回收期通常為 3 至 5 年。在大規模部署中,每年節省的成本可達數百萬美元。

方面 | 風冷 | 液冷 |

|---|---|---|

冷卻能力 | 最高約 30 kW/機櫃 | 支援更高密度部署 |

能耗節省 | PUE 較高,成本更高 | 冷卻能耗最多降低 90% |

投資回收期 | 因 PUE 懲罰較高而更長 | 40 kW 機櫃約 3–5 年 |

年度節省 | 有限 | 可達數百萬美元 |

冷卻能耗占比 | 約占總能耗 40% | 整體更高效 |

提示:切換至液冷系統,可顯著提升能源效率並降低整體擁有成本(TCO)。

穩定的硬體運行

AI 工作負載要求系統高度穩定。液冷從源頭管理熱量,使硬體在高密度環境下依然保持穩定運行。您可避免熱點與過熱問題,降低故障風險,保障持續運作能力。

現代資料中心部署越來越多高密度 AI 機櫃。

高效冷卻是保護設備安全的關鍵。

可靠基礎設施保障高可用性與熱穩定性。

液冷還能延長元件壽命。即使在超頻運行環境下,系統也能維持較低溫度,避免風冷常見的灰塵堆積與溫度不均問題。

永續性與碳減排

選擇液冷技術,您將為環境保護作出貢獻。該技術提升能源效率、降低營運成本並減少排放。同時,透過熱能回收再利用,支援循環能源模式。

優勢 | 對永續發展的影響 |

|---|---|

提升能源效率 | 降低營運成本與碳排放 |

節約資源 | 減少額外資源需求 |

熱能再利用 | 推動循環能源經濟,降低整體排放 |

資本與營運支出最高可降低一半。

整體擁有成本可降低 50%。

符合嚴格的環保法規與 ESG 標準。

提示:高效冷卻是建構綠色資料中心策略的重要基礎。

實務考量因素

系統設計與整合

在將液冷整合進 AI 資料中心時,您需要綜合評估多項因素。首先要確保與現有基礎設施相容。有時需要對設施進行改造或重新設計。您可以選擇直冷到晶片、浸沒式或混合式系統,每種方案各有優勢。液冷可提升能源效率,並支援餘熱再利用。雖然前期投入較高,但長期節省顯著。員工培訓同樣重要,因為液冷管理需要專業技能。選擇合適的冷卻液對安全與效能至關重要。

設計要點 | 說明 |

|---|---|

基礎設施相容性 | 根據機房佈局與功率密度支援改造或重建。 |

冷卻系統類型 | 在直冷到晶片、浸沒式或混合系統中做出最佳選擇。 |

能源效率與永續性 | 降低能耗並支援餘熱再利用。 |

成本因素 | 前期投資較高,但長期節省可觀。 |

維護與營運能力 | 員工需接受專業培訓以進行監控與維護。 |

冷卻液選擇 | 選擇兼具效能與安全性的流體介質。 |

提示:合理配置隔離閥與排氣裝置,有助於防止洩漏並簡化維護流程。

整合先進冷卻系統可提升效能與可靠性,避免過熱與熱降頻,延長硬體壽命,實現更高運行速度與更高可用性。

維護與可靠性

要確保液冷系統穩定運行,您需進行定期維護。保持清潔可防止過熱與故障。系統啟用前需進行調試與洩漏檢測。妥善管理流體液位與流速,以確保最佳冷卻效果。定期維護服務可及早發現問題並延長系統壽命。儲備關鍵備品零件可減少停機時間。

維護項目 | 說明 |

|---|---|

清潔管理 | 防止過熱並維持系統高效運行。 |

調試與驗收 | 投運前檢查洩漏與潛在問題。 |

流體管理 | 維持適當液位與流速。 |

定期服務 | 提前識別隱患並延長系統壽命。 |

備品管理 | 確保快速維修並減少停機時間。 |

液冷系統通常配備自動閥門與洩漏檢測功能,以降低風險。將液冷視為整體系統並實施主動維護策略,可顯著提升效率與可靠性。

部署挑戰

在採用液冷時,您可能面臨以下挑戰:

前期投資較高,可能讓中小型營運商猶豫。

系統設計與營運複雜度較高,需要專業規劃與工程能力。

流體管理與洩漏風險需嚴格監控與高品質密封設計。

提示:透過周密規劃與持續培訓,您可以克服這些挑戰,充分發揮液冷優勢。

液冷在 AIDC 的未來

支撐下一代 AI 擴充

AI 模型規模與複雜度不斷提升。下一代模型需要更多電力並產生更多熱量。液冷使您能夠支援超過 250 kW/機櫃的高密度部署,而這將完全超出風冷能力範圍。您可以持續升級硬體,以適應新一代 AI 晶片。

提示:在規劃機房佈局時優先考量液冷,將使您在新技術發布時快速適配。

產業趨勢

越來越多資料中心將液冷視為標準配置。大型雲端服務供應商與伺服器代管(colocation)企業持續加大投入。產業正朝向模組化與預製化冷卻方案發展,使部署與擴充更加便捷。同時,硬體廠商與冷卻技術公司加強合作,推動整合最佳化與創新。

趨勢 | 對您的意義 |

|---|---|

模組化冷卻系統 | 部署更快,升級更便捷 |

硬體與冷卻深度整合 | 提升效能與可靠性 |

永續發展導向 | 降低能耗,實現綠色營運 |

策略意義

及早採用液冷技術,將為您帶來競爭優勢。您可以以滿載運行最新 AI 工作負載,同時降低能源成本並符合環保法規。液冷幫助您實現資料中心的長期規劃,吸引重視效能與永續性的客戶。

站在產業變革前沿。

保護投資,應對 AI 技術演進。

打造面向未來的資料中心。

提示:液冷不僅是一種趨勢,更是塑造 AI 資料中心未來的策略選擇。

如今您可以清楚看到,到 2026 年,液冷已不再是可選方案,而是 AIDC 的必備技術。它為您帶來更高效能、更優能效與更強永續性,幫助您滿足下一代 AI 需求,同時降低成本並實現綠色目標。

立即行動:在資料中心規劃中優先部署液冷。您將保持領先地位,保障投資安全,建構面向未來的營運體系。

常見問題(FAQ)

液冷對 AI 資料中心的最大優勢是什麼?

液冷可提供更高的散熱效率,使高效能 AI 硬體在不降頻的情況下穩定運行,同時節能降本。

現有資料中心可以改造為液冷嗎?

可以。許多系統支援改造升級。雖然可能需要對部分設施進行調整,但無需完全重建機房。

液冷是否需要特殊維護?

需要定期檢查洩漏與冷卻液品質。員工需學習新的維護流程,但自動化監控系統可簡化大部分操作。

液冷對硬體安全嗎?

液冷系統採用非導電液體與密封設計,可有效降低洩漏或意外損壞風險,確保硬體安全。