2026 年液冷技术如何重塑 AIDC 性能

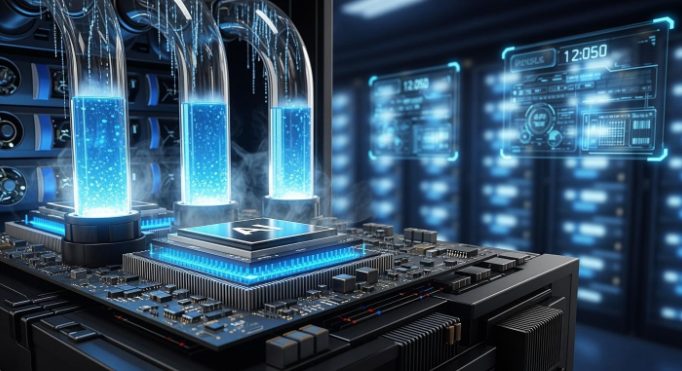

随着液冷技术成为满足现代工作负载需求的关键方案,您将看到 AI 数据中心 正经历重大变革。这项技术如今在行业中占据主导地位,帮助您应对高功率密度挑战并提升运营效率。在数字基础设施高度发达的地区,例如 香港服务器租用 环境中,液冷在支持高性能 AI 集群的同时,也在保障能效与空间优化方面发挥着关键作用。

优势 | 说明 |

|---|---|

能源效率 | 相比风冷提升最高可达 15% 的能效。 |

冷却成本降低 | 显著降低冷却相关成本。 |

服务器密度 | 支持更高的服务器密度,满足 AI 工作负载需求。 |

硬件寿命 | 延长硬件组件的使用寿命。 |

空间与维护 | 减少占地空间和维护需求。 |

借助液冷技术,您可以让系统保持峰值性能运行,延长硬件寿命并降低成本。随着 AI 工作负载持续增长,业内专家一致认为,这种方案不仅高效,而且已成为运营所必需。

核心要点

与风冷相比,液冷可提升最高 15% 的能源效率,从而实现显著成本节约。

该技术支持更高的服务器密度,使数据中心能够高效承载现代 AI 工作负载。

通过减少热应力,液冷延长硬件寿命,确保长期稳定运行。

采用液冷有助于降低能耗和碳排放,实现可持续发展目标。

投资液冷技术,是让数据中心在 AI 时代保持竞争力的关键举措。

液冷对 AIDC 的影响

性能与效率提升

当您将数据中心升级为液冷系统时,会看到运行方式的显著提升。如今 70%–80% 的先进 AI 数据中心已采用液冷技术,显示出其行业主导地位。您可以支持每机柜 200 kW 甚至更高的功率密度,这是传统方式无法实现的。

指标 | 说明 |

|---|---|

计算电力效率(PCE) | 从风冷约 0.4 提升至 0.9 以上,实现更高电力转化效率。 |

水资源使用效率(WUE) | 设施级别接近 0 WUE,比浸没式系统减少 80% 冷却液使用量。 |

可持续性 | 降低能耗与用水量,并通过减少热应力延长硬件寿命。 |

成本因素 | 尽管初始投资较高,但长期运营成本更低。 |

您可以实现源头直接散热、更高效的热传导,并减少对机械制冷机的依赖。这意味着更低的能源与维护支出。大型数据中心每年可节省高达 400 万美元的冷却成本。当冷却液温升允许达到 20°C 时,冷却能耗可降低 40%,用水量最多可减少 60%。

提示:采用液冷技术,可让硬件保持峰值性能运行,避免因过热导致的性能下降。

更高密度与可扩展性

随着 AI 工作负载不断增长,您需要在有限空间内部署更多算力。液冷使这一目标成为可能。现代 AI 系统通常需要每机柜 40–250 kW 的功率。传统数据中心冷却方式无法支持超过 15 kW/机柜,而液冷则能轻松应对更高密度。例如,NVIDIA 的 GB200 NVL72 机柜功率约为 140 kW,未来系统甚至可能达到 250 kW。

功率密度(kW/机柜) | 说明 |

|---|---|

100+ | 适用于先进 AI 工作负载的高密度环境。 |

140 | NVIDIA GB200 NVL72 机柜实现的功率。 |

250 | 下一代系统预计功率。 |

您可以放心扩展业务,无需担心过热或性能下降。液冷支持每机柜部署更多服务器,减少空间占用,并避免热降频现象,使数据中心扩展更加高效。

液冷满足现代 AI 工作负载需求。

支持更高功率密度管理。

是高性能计算运行的关键保障。

可持续发展进步

采用液冷技术,您将在提升数据中心可持续性方面发挥重要作用。该技术帮助降低能耗和用水量,支持绿色发展战略。先进液冷结合更高服务器利用率,可降低 7% 的二氧化碳排放。用水量减少 29%,配合其他优化措施,总体可降低 32%。若选址在水资源压力较小地区并采用高效冷却方式,用水需求最多可减少 52%。

优势 | 说明 |

|---|---|

降低碳足迹 | 减少整体能源使用 |

热水再利用 | 可为建筑或周边设施供热 |

闭环系统 | 通过高效设计节约用水 |

支持高密度边缘部署 | 减少对 HVAC 系统的依赖 |

您还可以帮助企业实现全球可持续发展目标与 ESG 指标。对于希望保持竞争力与社会责任感的数据中心而言,液冷已成为必然选择。

风冷的局限性

功率与热限制

当您依赖风冷系统时,将面临严格的限制。风冷通常只能支持每机柜 50–100 kW 的功率密度。现代 AI 芯片单颗可产生高达 1,200 瓦的热量,这对冷却系统造成巨大压力,也显著增加用电量。在部分地区,数据中心已占到总电力消耗的 20%。而仅风冷系统本身,就可能消耗设施总电力的 40%。

指标 | 数值 |

|---|---|

机柜密度 | 50–100 kW |

芯片级热功率 | 单颗最高 1,200 瓦 |

数据中心用电占比 | 2024 年爱尔兰总电力的 20% |

风冷电力消耗 | 最高占设施总电力的 40% |

这些限制使扩展变得困难。随着 AI 工作负载增长,您需要的功率与散热能力已远超风冷所能承载。

热降频风险

风冷还会带来系统性能下降的风险。灰尘和颗粒物会沉积在电路板上,阻碍气流并提升温度。风扇与散热器积尘后效率下降,导致温度骤升。硫氧化物、氯气等腐蚀性气体会损害金属部件,引发故障。湿度控制不当可能产生冷凝水或静电放电风险,均会威胁硬件安全。

风险类型 | 说明 |

|---|---|

颗粒物污染(PM) | PM2.5 和 PM10 可沉积在电路板上,增加短路风险并阻碍气流。 |

灰尘堆积 | 灰尘降低散热效率,引发温度骤升与热降频。 |

腐蚀性气体 | 损坏金属表面,导致信号丢失与机械故障。 |

湿度风险 | 湿度过高会冷凝腐蚀,湿度过低增加静电风险。 |

当冷却系统无法及时散热时,硬件会自动降频以避免过热,从而导致性能下降,并缩短设备寿命。

为何风冷无法满足 AI 需求

AI 工作负载使数据中心面临前所未有的挑战。与传统服务器任务相比,AI 应用产生的热量可高出十倍。现代 AI 加速器长时间满载运行,使热管理更加困难。您必须采用先进冷却方案才能应对。

AI 计算比普通云应用消耗更多能源。

高密度设备产生大量热量,风冷难以有效控制。

强制送风系统在边缘部署或城市紧凑空间中效率有限。

物理规律不会说谎——传统风冷已无法应对下一代 AI 工作负载的热密度。这不再是偏好问题,而是技术可行性问题。

因此,液冷不只是升级选项,而是现代 AI 数据中心的必然选择。

液冷技术类型

直冷到芯(Direct-to-Chip)

直冷到芯技术将冷板直接安装在处理器与内存上,从源头带走热量。系统可采用单相或双相冷却方式。单相系统中,冷却液吸热后输送至换热器;双相系统则利用特殊液体在吸热后蒸发,将热量带走。

相比风冷,显著提升能源效率。

提高数据中心冷却密度,支持更高服务器部署量。

减少对 HVAC 系统依赖,运行更安静。

提升可靠性与性能。

设计更灵活,便于升级。

通过提高机柜算力密度降低总体拥有成本。

浸没式冷却

浸没式冷却将服务器完全浸入专用矿物基绝缘液体中。该液体吸收设备产生的全部热量,大幅减少对空气冷却的需求。单个冷却槽可处理高达 100 kW,适用于高性能 AI 与 HPC 工作负载。系统可按 240 kW 为单位扩展,便于未来规划。同时,该方式有助于降低二氧化碳排放。

对 AI 工作负载的重要性

面对现代 AI 需求,液冷提供远优于风冷的热管理能力。其散热效率高出 2–10 倍,温度可降低 15–30°C。这样的能效水平是保障高密度 AI 运算稳定运行的关键。

冷却技术 | 散热效率 | 温度降低 | 适用场景 |

|---|---|---|---|

液冷 | 高出 2–10 倍 | 降低 15–30°C | 高密度计算 |

风冷 | 基准水平 | 温度较高 | 一般应用 |

提示:若希望数据中心具备未来竞争力,应优先部署直冷到芯或浸没式冷却系统。

2026 年液冷的核心优势

能源效率与成本节约

从运营成本角度看,液冷为您带来显著优势。该技术可支持远高于风冷系统的机柜密度,并将冷却能耗最多降低 90%。对于 40 kW 机柜,投资回收期通常为 3 至 5 年。在大规模部署中,每年节省的成本可达数百万美元。

方面 | 风冷 | 液冷 |

|---|---|---|

冷却能力 | 最高约 30 kW/机柜 | 支持更高密度部署 |

能耗节约 | PUE 较高,成本更高 | 冷却能耗最多降低 90% |

投资回收期 | 因 PUE 惩罚较高而更长 | 40 kW 机柜约 3–5 年 |

年度节省 | 有限 | 可达数百万美元 |

冷却能耗占比 | 约占总能耗 40% | 整体更高效 |

提示:切换至液冷系统,可显著提升能源效率并降低总体拥有成本(TCO)。

稳定的硬件运行

AI 工作负载要求系统高度稳定。液冷从源头管理热量,使硬件在高密度环境下依然保持稳定运行。您可避免热点与过热问题,降低故障风险,保障持续运行能力。

现代数据中心部署越来越多高密度 AI 机柜。

高效冷却是保护设备安全的关键。

可靠基础设施保障高可用性与热稳定性。

液冷还能延长组件寿命。即便在超频运行环境下,系统也能保持较低温度,避免风冷常见的灰尘积聚与温度不均问题。

可持续性与碳减排

选择液冷技术,您将为环境保护做出贡献。该技术提升能源效率、降低运营成本并减少排放。同时,通过热能回收利用,支持循环能源模式。

优势 | 对可持续发展的影响 |

|---|---|

提升能源效率 | 降低运营成本与碳排放 |

节约资源 | 减少额外资源需求 |

热能再利用 | 推动循环能源经济,降低总体排放 |

资本与运营支出最高可降低一半。

总体拥有成本可降低 50%。

满足严格的环保法规与 ESG 标准。

提示:高效冷却是构建绿色数据中心战略的重要基础。

实践考虑因素

系统设计与集成

在将液冷整合进 AI 数据中心时,您需要综合评估多项因素。首先要确保与现有基础设施兼容。有时需要对设施进行改造或重新设计。您可以选择直冷到芯、浸没式或混合式系统,每种方案各有优势。液冷可提升能源效率,并支持余热再利用。虽然前期投入较高,但长期节省显著。员工培训同样重要,因为液冷管理需要专业技能。选择合适的冷却液对安全与性能至关重要。

设计要点 | 说明 |

|---|---|

基础设施兼容性 | 根据机房布局与功率密度支持改造或重建。 |

冷却系统类型 | 在直冷到芯、浸没式或混合系统中做出最佳选择。 |

能源效率与可持续性 | 降低能耗并支持余热再利用。 |

成本因素 | 前期投资较高,但长期节省可观。 |

维护与运维能力 | 员工需接受专业培训以进行监控与维护。 |

冷却液选择 | 选择性能与安全性兼具的流体介质。 |

提示:合理配置隔离阀与排气装置,有助于防止泄漏并简化维护流程。

集成先进冷却系统可提升性能与可靠性,避免过热与热降频,延长硬件寿命,实现更高运行速度与更高可用性。

维护与可靠性

要确保液冷系统稳定运行,您需进行定期维护。保持清洁可防止过热与故障。系统启用前需进行调试与泄漏检测。合理管理流体液位与流速,以确保最佳冷却效果。定期维护服务可及早发现问题并延长系统寿命。储备关键备件可减少停机时间。

维护方面 | 说明 |

|---|---|

清洁管理 | 防止过热并保持系统高效运行。 |

调试与验收 | 投运前检查泄漏与潜在问题。 |

流体管理 | 维持合适液位与流速。 |

定期服务 | 提前识别隐患并延长系统寿命。 |

备件管理 | 确保快速维修并减少停机时间。 |

液冷系统通常配备自动阀门与泄漏检测功能,以降低风险。将液冷视为整体系统并实施主动维护策略,可显著提升效率与可靠性。

部署挑战

在采用液冷时,您可能面临以下挑战:

前期投资较高,可能让中小型运营商犹豫。

系统设计与运维复杂度较高,需要专业规划与工程能力。

流体管理与泄漏风险需严格监控与高质量密封设计。

提示:通过周密规划与持续培训,您可以克服这些挑战,充分发挥液冷优势。

液冷在 AIDC 的未来

支撑下一代 AI 扩展

AI 模型规模与复杂度不断提升。下一代模型需要更多电力并产生更多热量。液冷使您能够支持超过 250 kW/机柜的高密度部署,而这将彻底超出风冷能力范围。您可以持续升级硬件,适应新一代 AI 芯片。

提示:在规划机房布局时优先考虑液冷,将使您在新技术发布时快速适配。

行业趋势

越来越多数据中心将液冷视为标准配置。大型云服务商与服务器托管(colocation)企业持续加大投入。行业正向模块化与预制化冷却方案发展,使部署与扩展更加便捷。同时,硬件厂商与冷却技术公司加强合作,推动集成优化与创新。

趋势 | 对您的意义 |

|---|---|

模块化冷却系统 | 部署更快,升级更便捷 |

硬件与冷却深度整合 | 提升性能与可靠性 |

可持续发展导向 | 降低能耗,实现绿色运营 |

战略意义

及早采用液冷技术,将为您带来竞争优势。您可以以满负荷运行最新 AI 工作负载,同时降低能源成本并满足环保法规。液冷帮助您实现数据中心的长期规划,吸引注重性能与可持续性的客户。

走在行业变革前沿。

保护投资,应对 AI 技术演进。

打造面向未来的数据中心。

提示:液冷不仅是一种趋势,更是塑造 AI 数据中心未来的战略选择。

如今您可以清楚看到,到 2026 年,液冷已不再是可选方案,而是 AIDC 的必需技术。它为您带来更高性能、更优能效与更强可持续性,帮助您满足下一代 AI 需求,同时降低成本并实现绿色目标。

立即行动:在数据中心规划中优先部署液冷。您将保持领先地位,保障投资安全,构建面向未来的运营体系。

常见问题(FAQ)

液冷对 AI 数据中心的最大优势是什么?

液冷可提供更高的散热效率,使高性能 AI 硬件在不降频的情况下稳定运行,同时节能降本。

现有数据中心可以改造为液冷吗?

可以。许多系统支持改造升级。虽然可能需要对部分设施进行调整,但无需完全重建机房。

液冷是否需要特殊维护?

需要定期检查泄漏与冷却液质量。员工需学习新的维护流程,但自动化监控系统可简化大部分操作。

液冷对硬件安全吗?

液冷系统采用非导电液体与密封设计,可有效降低泄漏或意外损坏风险,确保硬件安全。